W dzisiejszej hiperkonkurencyjnej gospodarce cyfrowej poleganie wyłącznie na intuicji już nie wystarcza. Monitoring rynku, competitive intelligence i decyzje oparte na danych są kluczowe, by utrzymać przewagę. Internet jest pełen publicznie dostępnych danych — od cen, przez oferty pracy, po opinie klientów i sygnały związane z AI — mimo to wiele firm wciąż unika data scrapingu z powodu utrwalonych mitów.

Cel? Pokazać, że scraping danych może być legalną, skalowalną i wiarygodną podstawą nowoczesnej analityki biznesowej i rozwiązań opartych na AI.

🔍 Dlaczego monitoring rynku jest dziś ważniejszy niż kiedykolwiek 🔍

Monitoring rynku to ciągły proces zbierania i analizowania danych z firmowych stron internetowych, ogłoszeń o pracę, systemów monitoringu cen oraz innych publicznych źródeł danych, aby zrozumieć, co dzieje się w branży — tu i teraz.

Dlaczego to kluczowe:

- Rynki zmieniają się błyskawicznie: ceny, popyt i działania konkurencji potrafią zmieniać się z dnia na dzień

- Konkurenci korzystają z automatyzacji: scraper boty i AI tools są już standardem

- Dane w czasie rzeczywistym wygrywają z raportami: klasyczne analizy szybko się dezaktualizują

Dynamiczny rozwój ekosystemu data scrapingu i web crawlingu pokazuje, jak centralną rolę odgrywają one dziś w badaniach rynku i competitive intelligence. Firmy coraz częściej inwestują w zautomatyzowaną kolekcję danych, aby śledzić ceny, modele AI, job postings i zmiany strukturalne na rynku.

🧱 Mity blokujące skuteczny competitive intelligence 🧱

Pomimo rosnącej adopcji, wiele organizacji nadal unika scrapingu z powodu strachu i niejasności. Najczęstsze obawy to:

- „Czy web scraping nie jest nielegalny?”

- „Czy nie trzeba być programistą, żeby scrapować dane?”

- „Czy dane ze scrapingu nie są chaotyczne i niewiarygodne?”

Te błędne przekonania spowalniają zespoły data-driven, zmuszając je do korzystania z niepełnych insightów lub ręcznych metod analizy. Tymczasem prawidłowo prowadzony data scraping jest jednym z najskuteczniejszych sposobów zbierania wysokiej jakości data points na dużą skalę.

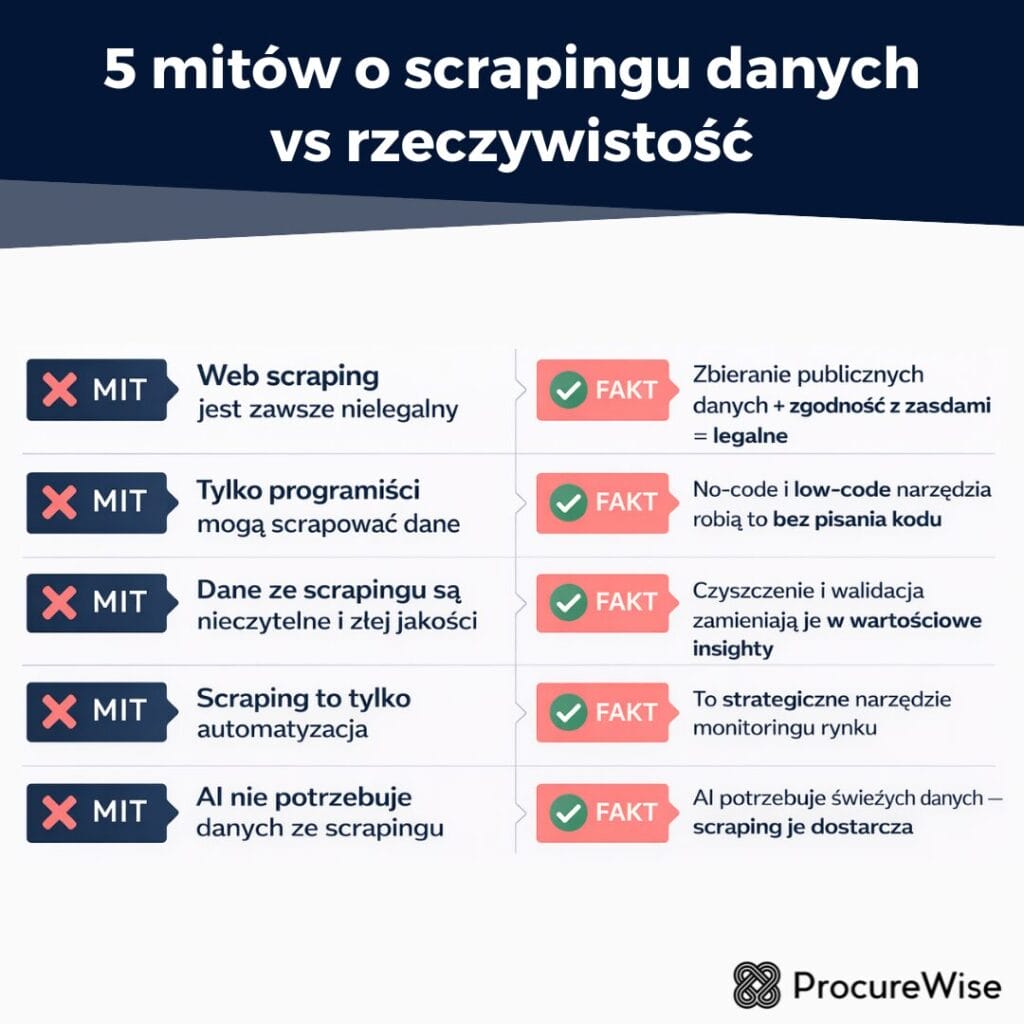

Zrozumienie, co jest mitem, a co faktem, to pierwszy krok do skutecznego monitoringu rynku.

🧭 Co obejmuje ta seria 🧭

W tej serii pokażemy, jak web scraping działa w praktyce — i dlaczego jest znacznie mniej ryzykowny, niż się powszechnie uważa. Omówimy m.in.:

- Ramy prawne i Terms of Service

- Publicly available data vs. dane ograniczone

- Scraping tools, crawler bots i AI tools

- Jakość danych, czyszczenie i walidację

- Jak dane ze scrapingu zasilają modele AI i analitykę

Celem jest jedno: pomóc Ci spojrzeć na data scraping nie jak na „szarą strefę”, ale jak na kluczową kompetencję nowoczesnego monitoringu rynku.

⚖️ Mit 1: „Data scraping jest zawsze nielegalny i nieetyczny” ⚖️

To największy i najbardziej szkodliwy mit — i po prostu nieprawdziwy.

Rzeczywistość danych publicznie dostępnych 📂

Scrapowanie publicznie dostępnych danych — czyli treści dostępnych bez logowania, paywalla czy omijania zabezpieczeń — to zupełnie co innego niż hacking czy kradzież danych. Wyszukiwarki internetowe robią to codziennie za pomocą web crawlerów.

Kluczowe rozróżnienie:

- ❌ Scrapowanie danych prywatnych, zamkniętych lub wrażliwych bez zgody

- ✅ Zbieranie danych otwartych z company websites, job postings czy list cenowych

Legalność zależy od sposobu zbierania danych, rodzaju danych oraz poszanowania obowiązujących zasad.

Terms of Service i robots.txt nadal mają znaczenie 📜

Nawet w przypadku danych publicznych odpowiedzialny scraping oznacza:

- Respektowanie website terms of service

- Przestrzeganie zaleceń pliku robots.txt

- Unikanie agresywnych scraper bots, które przeciążają serwery

To właśnie tu spotykają się etyczna kolekcja danych i dobre praktyki techniczne.

Dlaczego ten mit wciąż istnieje ⚠️

Wiele osób myli:

- naruszenia Computer Fraud and Abuse Act

- kwestie praw autorskich (DMCA)

- z legalnym data extraction na potrzeby analizy i badań

Tymczasem coraz więcej orzeczeń sądowych jasno pokazuje, że odpowiedzialne scrapowanie danych publicznych nie jest równoznaczne z nieautoryzowanym dostępem.

🧑💻 Mit 2: Trzeba być ekspertem od programowania, żeby scrapować dane 🧑💻

To jeden z najbardziej uporczywych mitów o data scrapingu. Przez lata wiele firm zakładało, że web scraping jest zarezerwowany wyłącznie dla programistów i data scientistów. Dziś to założenie jest po prostu nieaktualne.

Rozwój scraping tools, AI tools oraz rozwiązań no-code i low-code całkowicie zmienił zasady gry w monitoringu rynku i competitive intelligence.

Od ręcznego kodowania do narzędzi przyjaznych biznesowi 🛠️

Kiedyś scraping oznaczał:

- pisanie skryptów w Pythonie,

- ręczne zarządzanie crawlerami,

- konfigurację proxy i infrastruktury.

Dziś większość firm korzysta z narzędzi, które:

- automatyzują web crawling,

- obsługują data extraction i aktualizacje,

- eliminują konieczność pisania kodu.

Efekt? Scraping stał się dostępny dla zespołów biznesowych, nie tylko technicznych.

No-code i low-code w monitoringu rynku 🧩

Nowoczesne platformy do scrapingu umożliwiają zbieranie publicly available data w sposób wizualny i intuicyjny.

Typowe możliwości:

- wskazywanie data points kliknięciem na stronie,

- monitoring cen, job postings i ofert konkurencji,

- harmonogramy do ciągłego market monitoring,

- eksport danych do BI, Excel lub AI models.

Dzięki temu analitycy, marketerzy i product managerowie mogą samodzielnie budować competitive intelligence, bez angażowania IT.

Kiedy programowanie nadal ma sens ⚙️

To nie znaczy, że kodowanie zniknęło całkowicie — po prostu nie jest już wymagane zawsze.

Klasyczne podejścia kodowe 🧠

- Python + Scrapy – do dużych, niestandardowych crawlerów

- Selenium – do dynamicznych stron opartych o JavaScript

- własne pipeline’y danych – do integracji z systemami wewnętrznymi

Kod sprawdza się tam, gdzie potrzebna jest:

- pełna kontrola nad logiką scrapingu,

- bardzo duża skala,

- złożone struktury danych.

Kluczowe jest jedno: to wybór, nie bariera wejścia.

Dynamiczne strony nie są już problemem 🧠

Częsta obawa brzmi: „Nowoczesne strony są dynamiczne, więc nie da się ich scrapować”.

W praktyce:

- współczesne narzędzia renderują JavaScript,

- obsługują lazy loading i paginację,

- symulują zachowanie użytkownika w sposób zgodny z zasadami.

Dzięki temu company websites, platformy e-commerce czy serwisy ofertowe są w pełni dostępne dla odpowiedzialnego scrapingu.

Co to oznacza dla competitive intelligence 📌

Bariera wejścia praktycznie zniknęła.

Nie potrzebujesz:

- zespołu data science,

- miesięcy developmentu,

- własnej infrastruktury.

Potrzebujesz:

- jasno określonych celów monitoringu rynku,

- znajomości zasad prawnych i terms of service,

- odpowiednio dobranych narzędzi.

Dziś data scraping to kompetencja biznesowa, a nie tylko techniczna.

🧹 Mit 3: Dane ze scrapingu są zawsze chaotyczne i niewiarygodne 🧹

To jeden z najczęstszych powodów, dla których firmy rezygnują z data scrapingu. Rzeczywiście — surowe dane zebrane z internetu mogą wyglądać na nieuporządkowane. Ale to nie wada scrapingu, tylko naturalny etap każdej kolekcji danych.

Prawda jest taka: odpowiednio przetworzone dane ze scrapingu stają się wiarygodnym i skalowalnym źródłem wiedzy dla monitoringu rynku, competitive intelligence i AI models.

Dlaczego surowe dane wyglądają na „brudne” 🧪

Strony internetowe są projektowane dla ludzi, nie dla algorytmów.

Najczęstsze problemy:

- różne formaty cen, dat i walut,

- duplikaty wynikające z paginacji i filtrów,

- zbędny HTML, znaki specjalne, elementy wizualne,

- zmiany struktury na company websites.

To samo dotyczy API i danych wewnętrznych — scraping jedynie ujawnia problem wcześniej.

Czyszczenie danych to standard, nie wada 🛠️

Nowoczesne scraping tools i AI tools traktują data cleaning jako kluczowy element procesu.

Typowe etapy:

- normalizacja formatów (ceny, daty, jednostki),

- deduplikacja rekordów,

- walidacja data points,

- ujednolicenie schematów pod analitykę i BI.

Dzięki temu dane są gotowe do monitoringu cen, analiz konkurencji i raportów zarządczych.

Jak zapewnić jakość i wiarygodność danych 📏

Jakość danych zależy bardziej od procesu niż od samego źródła.

Dobre praktyki:

- scrapowanie z wiarygodnych i spójnych źródeł,

- łączenie wielu serwisów w jednym pipeline,

- regularne harmonogramy crawlów,

- monitorowanie zmian strukturalnych stron,

- automatyczne wykrywanie błędów i anomalii.

Dlatego coraz więcej zespołów analitycznych opiera competitive intelligence właśnie na danych ze scrapingu.

Stronniczość danych i jak jej przeciwdziałać 🧠

Każdy zbiór danych może być stronniczy — także ten ze scrapingu.

Ryzyka:

- poleganie na jednym źródle,

- nadreprezentacja wybranej platformy,

- brak kontekstu regionalnego lub językowego.

Rozwiązanie? Różnorodność źródeł: ceny, job postings, opinie klientów, opisy produktów — wszystko w jednym obrazie rynku.

Dlaczego modele AI „lubią” dane ze scrapingu 🤖

Po oczyszczeniu dane ze scrapingu są idealnym paliwem dla:

- predykcji trendów,

- detekcji anomalii,

- systemów rekomendacyjnych,

- zaawansowanych AI models.

Strukturalne, aktualne dane z internetu pozwalają AI reagować na rynek szybciej niż tradycyjne raporty.

Najważniejszy wniosek 📌

Dane ze scrapingu nie są niewiarygodne — są surowe.

A surowe dane:

- po oczyszczeniu zyskują ogromną wartość,

- są skalowalne i elastyczne,

- stanowią fundament nowoczesnego monitoringu rynku.

- 🤖 Mit 4: Data scraping to tylko automatyzacja, a nie strategia 🤖

Wiele osób nadal postrzega web scraping jako czysto techniczne zadanie wykonywane przez scraper bots w tle. W rzeczywistości data scraping jest dziś silnikiem strategicznym dla monitoringu rynku, competitive intelligence oraz decyzji opartych na danych.

Scraping nie zastępuje myślenia — wzmacnia je.

Od danych do realnego monitoringu rynku 📊

Gdy scraping jest powiązany z celami biznesowymi, umożliwia:

- monitoring cen konkurencji w czasie rzeczywistym,

- śledzenie zmian strukturalnych na company websites,

- analizę job postings w celu identyfikacji trendów rekrutacyjnych,

- obserwację zmian w pozycjonowaniu produktów i komunikacji marek.

Dzięki temu dane z internetu stają się konkretną przewagą decyzyjną, a nie tylko zbiorem rekordów.

🧠 Mit 5: Scraping nie ma nic wspólnego z AI i zaawansowaną analityką 🧠

To jeden z najbardziej przestarzałych mitów.

Nowoczesne AI models potrzebują świeżych, zewnętrznych danych, aby generować trafne insighty — a data scraping jest jednym z najbardziej skalowalnych sposobów ich pozyskiwania.

Jak dane ze scrapingu napędzają AI ⚡

- trenowanie modeli uczenia maszynowego,

- zasilanie systemów generative AI,

- wykrywanie trendów i anomalii rynkowych,

- predykcyjną analizę zachowań rynku.

Bez automatycznej kolekcji danych nawet najlepsze AI szybko tracą aktualność.

Ciągła inteligencja zamiast jednorazowych raportów 🔄

Tradycyjne badania rynku są statyczne. Scraping umożliwia ciągły monitoring rynku.

Korzyści:

- szybsza reakcja na zmiany cen i ofert,

- wczesne wykrywanie ruchów konkurencji,

- krótsze cykle testowania i optymalizacji,

- lepsza współpraca zespołów biznesowych i analitycznych.

Dlatego dane ze scrapingu są fundamentem nowoczesnych platform competitive intelligence.

Odpowiedzialny scraping — warunek skalowania ⚖️

Wartość strategiczna istnieje tylko wtedy, gdy scraping jest prowadzony odpowiedzialnie.

Kluczowe zasady:

- poszanowanie website terms of service,

- zgodność z obowiązującymi przepisami prawa,

- rozsądne limity zapytań i etyczne zachowanie crawlerów,

- unikanie danych osobowych bez podstawy prawnej.

Odpowiedzialność to nie ograniczenie — to warunek długofalowej przewagi.

Podsumowanie: co naprawdę obalają te mity 🧭

- ❌ Scraping jest nielegalny → ✅ dane publiczne + zgodność z zasadami

- ❌ Tylko programiści scrapują → ✅ no-code i AI tools

- ❌ Dane są niewiarygodne → ✅ czyszczenie daje jakość

- ❌ Scraping nie jest strategiczny → ✅ napędza monitoring rynku

- ❌ AI nie potrzebuje scrapingu → ✅ AI bez danych nie działa

🚀 Wniosek końcowy: scraping jako przewaga konkurencyjna 🚀

W świecie AI, automatyzacji i dynamicznych rynków data scraping przestał być dodatkiem.

Dziś jest:

- fundamentem market research,

- narzędziem monitoringu cen,

- paliwem dla AI models,

- źródłem wiedzy o konkurencji, klientach i rynku pracy.

Skuteczny monitoring rynku zaczyna się od zrozumienia internetu — a nie od strachu przed nim.